„There is no cloud. It’s just someone else’s computer.“ Dieser Aufkleber hängt in IT-Abteilungen weltweit – und er enthält mehr Wahrheit als die meisten Whitepaper großer Cloud-Konzerne. Für KMUs stellt sich die Frage: Wessen Computer sind das eigentlich, was passiert mit den Daten darauf – und gibt es bessere Wege?

1. Der Mythos „Cloud“ und die Realität dahinter

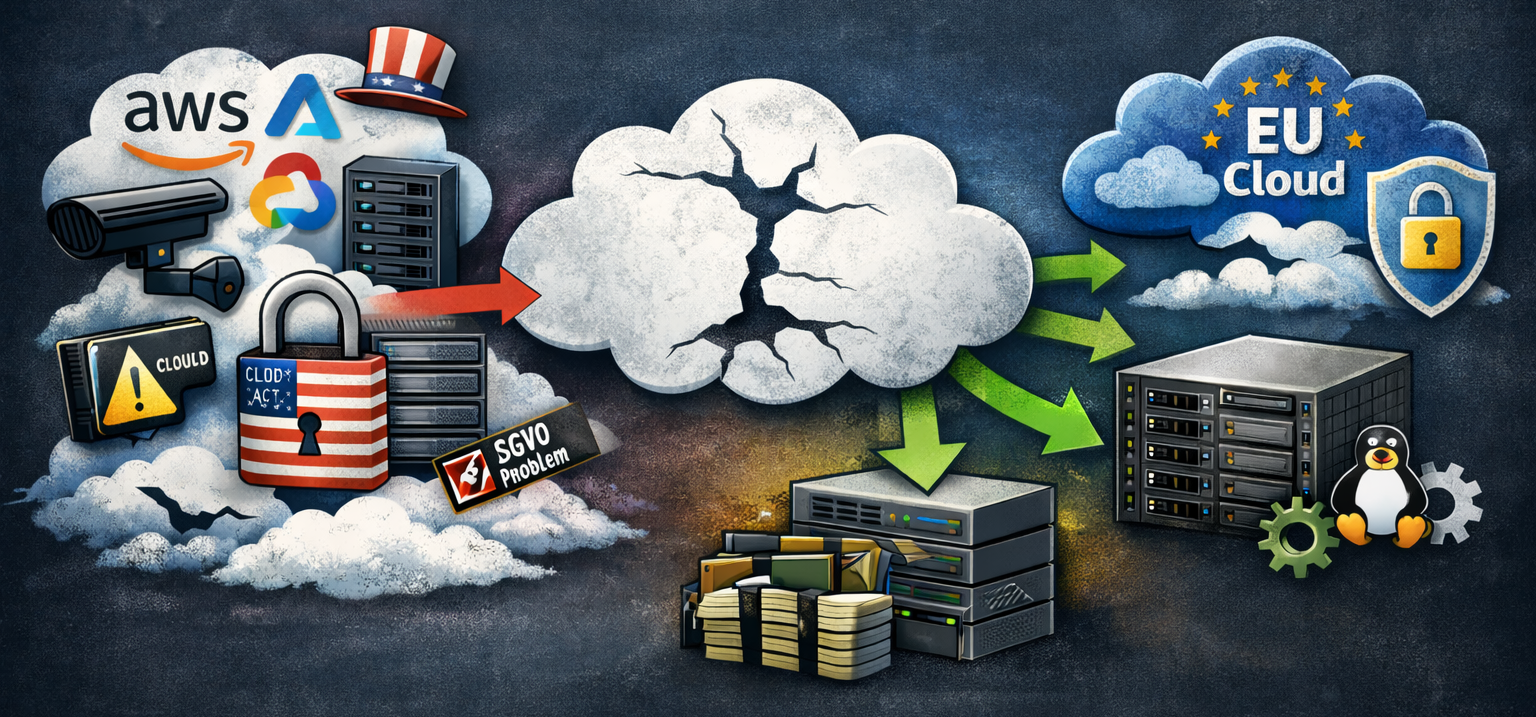

Die Cloud ist keine abstrakte digitale Wolke, die irgendwo in der Atmosphäre schwebt. Sie ist eine sehr konkrete Sammlung von Rechenzentren, die von privaten Unternehmen betrieben werden – größtenteils von drei amerikanischen Konzernen: Amazon Web Services, Microsoft Azure und Google Cloud. Zusammen kontrollieren sie über 65 Prozent des globalen Cloud-Infrastruktur-Marktes.

Wenn ein KMU seine Daten in die Cloud migriert, lagert es sie auf Rechnern aus, die einem amerikanischen Unternehmen gehören, nach amerikanischem Recht betrieben werden und für die US-Behörden unter bestimmten Bedingungen Zugriff verlangen können. Das ist keine Verschwörungstheorie – das ist die rechtliche Realität des CLOUD Act, den die USA 2018 verabschiedet haben.

Für viele Unternehmen war das jahrelang kein Thema. Die Cloud war günstig, skalierbar und bequem – der Rest schien juristisches Kleingedrucktes, um das sich andere kümmern sollten. Spätestens seit dem Schrems-II-Urteil des Europäischen Gerichtshofs von 2020 ist jedoch klar: Das Kleingedruckte hat sehr große praktische Konsequenzen.

2. Warum AWS, Azure und Google Cloud für KMUs ein DSGVO-Problem sind

Die Datenschutz-Grundverordnung ist kein bürokratisches Ärgernis. Sie ist der rechtliche Rahmen, der europäische Bürger und Unternehmen vor unkontrolliertem Datenzugriff schützt. Und sie kollidiert fundamental mit der Art, wie amerikanische Cloud-Anbieter operieren.

Das Kernproblem ist der CLOUD Act: Er verpflichtet amerikanische Unternehmen, US-Behörden auf Anfrage Zugang zu gespeicherten Daten zu gewähren – auch dann, wenn diese Daten auf Servern in Frankfurt, Amsterdam oder Dublin liegen. Der physische Standort der Server ist dabei irrelevant. Entscheidend ist die Nationalität des Unternehmens, das sie betreibt.

Das bedeutet: Wer Kundendaten, Mitarbeiterdaten oder vertrauliche Geschäftsunterlagen bei AWS, Azure oder Google Cloud speichert, kann nicht mit Sicherheit ausschließen, dass US-Behörden Zugriff auf diese Daten erhalten. Genau das aber verlangt die DSGVO: vollständige Kontrolle über personenbezogene Daten und die Fähigkeit, unbefugten Zugriff Dritter auszuschließen.

Der EuGH hat mit Schrems-II den vorherigen Rechtsrahmen – das Privacy Shield-Abkommen – für ungültig erklärt. Zwar wurde 2023 mit dem EU-US Data Privacy Framework (DPF) ein Nachfolger verabschiedet. Doch die Datenschutzorganisation NOYB von Max Schrems hat bereits Klagen gegen das DPF eingereicht, und europäische Datenschutzbehörden beobachten die Entwicklung kritisch. Wer auf diesem Rechtsrahmen aufbaut, baut damit möglicherweise erneut auf Sand.

Ein technischer Ausweg existiert: Wer seine Daten vor dem Upload in die Cloud clientseitig verschlüsselt und den Schlüssel ausschließlich im eigenen Unternehmen behält (sogenannte Client-Side Encryption oder Bring Your Own Key, BYOK), entzieht US-Behörden faktisch den nutzbaren Datenzugriff – sie erhalten im Zweifel nur unlesbaren Datensalat. Dieser Ansatz macht Cloud-Nutzung DSGVO-konformer, erfordert jedoch konsequente Umsetzung und schließt viele komfortable Cloud-Dienste aus, die auf serverseitigem Datenzugriff basieren.

Für KMUs, die BYOK nicht konsequent umsetzen können oder wollen, bleibt das Risiko real. Ein Datenschutzverstoß kann Bußgelder von bis zu vier Prozent des weltweiten Jahresumsatzes nach sich ziehen – und europäische Datenschutzbehörden werden zunehmend aktiver.

3. Die Preisfalle: Wenn günstig sehr teuer wird

Neben dem rechtlichen Problem gibt es ein wirtschaftliches, das in vielen KMUs erst nach der Migration zur Cloud richtig sichtbar wird: die Kostenfalle.

Der Einstieg in AWS, Azure oder Google Cloud ist bewusst günstig gestaltet. Kostenlose Kontingente, großzügige Startkredite und scheinbar niedrige Grundpreise senken die Hemmschwelle. Doch Cloud-Pricing ist komplex – absichtlich komplex. Rechenleistung, Speicher, Datentransfer, API-Aufrufe, Load Balancer, Backup-Dienste: Jede Komponente wird separat abgerechnet, und die Kosten summieren sich schneller als erwartet.

Besonders tückisch ist der Egress-Traffic – also die Kosten für ausgehende Daten. Daten in die Cloud zu laden ist meist günstig oder kostenlos. Daten wieder herauszuholen ist dagegen teuer: AWS berechnet je nach Region zwischen 0,08 und 0,09 US-Dollar pro Gigabyte für ausgehenden Traffic im Dauerbetrieb. Wer täglich größere Datenmengen zwischen Cloud und eigenem Standort bewegt, zahlt dafür dauerhaft und erheblich. Ein Hinweis der Vollständigkeit halber: Im Zuge des europäischen Data Acts haben AWS, Azure und Google 2024 angekündigt, Egress-Gebühren für Kunden zu erlassen, die den Anbieter vollständig wechseln. Für den laufenden hybriden Betrieb zwischen Cloud und On-Premise bleiben diese Kosten jedoch vollständig bestehen.

Hinzu kommt das Phänomen des Vendor Lock-ins. Wer einmal tief in das Ökosystem eines Cloud-Anbieters investiert hat – proprietäre Datenbanken, serverlose Funktionen, spezifische Speicherdienste – steckt fest. Ein Wechsel zu einem anderen Anbieter wird mit der Zeit immer teurer und aufwendiger. Das ist kein Designfehler dieser Plattformen, sondern ein Geschäftsmodell. Viele KMUs berichten, dass ihre Cloud-Kosten nach zwei bis drei Jahren das Dreifache der ursprünglichen Kalkulation erreicht haben.

4. Eigene Infrastruktur: Kontrolle mit Konsequenzen

Die naheliegende Antwort auf all diese Probleme klingt einfach: eigene Server, eigene Kontrolle, eigene Daten. Und tatsächlich ist das für viele KMUs die richtigere Lösung – aber sie kommt mit ihren eigenen, oft unterschätzten Herausforderungen.

Hardware ist das erste Problem. Moderne Workloads stellen wachsende Anforderungen an Rechenleistung und Speicher. Server, die heute ausreichend dimensioniert sind, können in zwei Jahren zu klein sein. Im Gegensatz zur Cloud skaliert eigene Hardware nicht auf Knopfdruck.

Betrieb und Wartung ist das zweite – und oft unterschätzte – Problem. Ein eigener Server braucht jemanden, der ihn kennt, wartet und im Notfall auch nachts um drei Uhr wiederherstellt. Das bedeutet Betriebssystem-Updates, Hardware-Monitoring, Backup-Management und Incident Response. Ein erfahrener Linux-Administrator, der Proxmox, Docker und Monitoring sicher betreibt und pflegt, kostet ein KMU realistisch 60.000 bis 80.000 Euro im Jahr – Gehalt, Sozialabgaben und Weiterbildung eingerechnet. Die Cloud ist oft deshalb teuer, weil sie diese Personalkosten durch Automatisierung teilweise ersetzt. Wer auf Eigenbetrieb setzt, muss diese Kosten ehrlich gegengrechnen.

IT-Sicherheit ist das dritte und kritischste Problem. Es ist wichtig, hier ehrlich zu sein: Für ein durchschnittliches KMU ist das Risiko, dass US-Behörden via CLOUD Act ihre Daten lesen, statistisch verschwindend gering. Das Risiko, dass eine Ransomware-Gruppe eine ungepatchte Sicherheitslücke im selbst gehosteten Stack ausnutzt, ist dagegen sehr real. AWS, Azure und Google beschäftigen jeweils Tausende Sicherheitsingenieure. Ein KMU hat oft einen IT-Verantwortlichen. Selbst-Hosting erfordert daher eine extrem hohe Security-Disziplin – regelmäßige Updates, Netzwerksegmentierung, Backup-Tests, Zugriffskontrollen. Ohne diese Disziplin wird das DSGVO-Problem nicht kleiner, sondern größer: Ein Datenleck durch einen Hack ist weitaus wahrscheinlicher als ein behördlicher Zugriff via CLOUD Act.

5. Europäische Cloud-Anbieter: Souverän, aber kein Allheilmittel

Zwischen den großen amerikanischen Hyperscalern und der vollständig selbst betriebenen Infrastruktur gibt es eine mittlere Option: europäische Cloud-Anbieter.

Die Schwarz-Gruppe – bekannt durch Lidl und Kaufland – betreibt mit Stackit eine eigene Cloud-Plattform, die explizit auf europäische DSGVO-Anforderungen ausgerichtet ist. Stackit läuft ausschließlich auf europäischen Servern, unterliegt europäischem Recht und hat keinerlei Verbindung zu US-amerikanischen Mutterkonzernen. Das ist ein echter rechtlicher Unterschied zu AWS-Regionen in Frankfurt, hinter denen weiterhin amerikanisches Konzernrecht steht.

OVHcloud aus Frankreich ist einer der größten europäischen Cloud-Anbieter überhaupt und bietet ein breites Portfolio von einfachem Hosting bis hin zu komplexen Private-Cloud-Setups. Vollständig europäisch, börsennotiert in Paris und ohne CLOUD-Act-Risiko. Erwähnenswert: OVH hat gridscale im August 2023 vollständig übernommen – wer gridscale bisher als eigenständige Alternative kannte, findet es nun als Teil des OVH-Ökosystems.

Der wichtige Vorbehalt bleibt bestehen: Auch europäische Cloud-Anbieter lösen das grundlegende Cloud-Problem nicht vollständig. Die Daten liegen weiterhin auf fremden Rechnern. Vendor Lock-in ist weniger ausgeprägt als bei AWS, aber vorhanden. Und die Skalierbarkeit sowie der Funktionsumfang erreichen nicht das Niveau der amerikanischen Hyperscaler – was für viele KMUs jedoch irrelevant ist, weil sie diese Skalierbarkeit schlicht nicht brauchen.

6. Dedizierte Server bei Hetzner und OVH: Die unterschätzte Mitte

Es gibt eine Option, die in der Cloud-Diskussion erstaunlich selten auftaucht, obwohl sie für viele KMUs wirtschaftlich und datenschutzrechtlich sehr sinnvoll sein kann: dedizierte Server bei europäischen Hosting-Anbietern – kombiniert mit einem selbst verwalteten Open-Source-Stack.

Hetzner aus Gunzenhausen in Bayern ist in der europäischen Tech-Community ein offenes Geheimnis. Dedizierte Server mit aktueller Hardware – Intel- oder AMD-Prozessoren, 64 bis 256 GB RAM, NVMe-SSDs – sind bereits ab etwa 40 bis 80 Euro pro Monat verfügbar. Der Server wird ausschließlich für einen Kunden betrieben: kein geteilter Hypervisor, keine gemeinsamen Ressourcen, volle Kontrolle über Betriebssystem und Software-Stack. OVH und Webtropia bieten ähnliche Modelle zu wettbewerbsfähigen Preisen, ebenfalls mit europäischem Rechtsrahmen.

Was bedeutet das für ein KMU? Wer auf einem dedizierten Hetzner-Server eine eigene Infrastruktur aufbaut, bekommt eine Lösung mit DSGVO-konformem Rechtsrahmen, planbaren monatlichen Kosten und professioneller Rechenzentrumsinfrastruktur – unterbrechungsfreier Strom, Klimatisierung, redundante Netzwerkanbindung – ohne selbst ein Rechenzentrum betreiben zu müssen.

Der entscheidende Haken: Diese Lösung skaliert nicht unendlich und setzt voraus, dass die unter Abschnitt 4 beschriebenen Personalkosten und Security-Anforderungen gedeckt sind. Wachstum bedeutet manuellen Aufwand: neuen Server bestellen, einrichten, integrieren. Für KMUs mit stabilem oder moderat wachsendem Betrieb ist das ein akzeptabler Kompromiss – aber nur dann, wenn die nötige IT-Kompetenz vorhanden ist oder eingekauft wird.

7. Open-Source-Stack: Was man auf eigenen Servern aufbauen kann

Ein dedizierter Server ist nur die Hardware. Was darauf läuft, entscheidet über den tatsächlichen Nutzen. Das Open-Source-Ökosystem bietet hier eine beeindruckend vollständige Werkzeugkiste.

Virtualisierung bildet die Grundlage. Mit Proxmox Virtual Environment lässt sich auf einem einzigen dedizierten Server eine vollwertige Virtualisierungsplattform aufbauen, die VMs und Container verwaltet – kostenlos, Open Source und mit moderner Web-Oberfläche. Wer mehrere Server betreibt, kann diese zu einem Cluster zusammenschließen und damit Hochverfügbarkeit und Live-Migration von VMs realisieren.

Container-Orchestrierung mit Docker Swarm ermöglicht es, Anwendungen containerisiert und skalierbar zu betreiben. Docker Swarm ist dabei deutlich einfacher zu betreiben als Kubernetes und für KMU-Workloads in vielen Fällen vollkommen ausreichend.

Datenspeicherung und Zusammenarbeit deckt Nextcloud ab – die Open-Source-Alternative zu Google Drive und Microsoft 365. Dateisynchronisation, Kalender, Kontakte, Videokonferenzen und kollaborative Dokumentenbearbeitung laufen damit vollständig auf dem eigenen Server.

Monitoring und Observability liefern Prometheus und Grafana – ein Duo, das professionelles Infrastruktur-Monitoring auf Enterprise-Niveau kostenlos und offen bereitstellt. Wer weiß, was auf seinen Servern passiert, kann Probleme erkennen, bevor sie zu Ausfällen werden.

Entwicklungsinfrastruktur runden Gitea als selbst gehostetem Git-Server und Woodpecker CI als Deployment-Pipeline ab. Damit entsteht eine vollständige Entwicklungsumgebung ohne externe Abhängigkeiten.

Das Ergebnis ist eine Infrastruktur, die in ihrer Funktionalität mit vielen kommerziellen Cloud-Diensten mithalten kann – zu einem Bruchteil der laufenden Lizenzkosten, vollständig unter eigener Kontrolle. Allerdings gilt: Dieser Stack muss von jemandem betrieben werden, der ihn kennt. Er ist kein Selbstläufer.

8. Das ehrliche Fazit: Kein Weg ist perfekt

Die Wahrheit über Cloud-Infrastruktur für KMUs hat keine einfache Antwort – und wer eine einfache Antwort verkauft, verkauft etwas anderes mit.

AWS, Azure und Google Cloud sind technisch beeindruckend und praktisch bequem. Für europäische Unternehmen mit personenbezogenen Daten sind sie jedoch rechtlich riskant, sofern keine konsequente clientseitige Verschlüsselung (BYOK) eingesetzt wird. Die Preisfallen sind real, der Vendor Lock-in ist eine strategische Entscheidung, die man bewusst treffen sollte.

Vollständig eigene Infrastruktur gibt maximale Kontrolle – erfordert aber Personalressourcen, Security-Expertise und Planungsaufwand, den nicht jedes KMU aufbringen kann. Die eingesparten Cloud-Kosten können durch Personalkosten schnell wieder aufgefressen werden.

Europäische Cloud-Anbieter wie Stackit bieten einen guten Mittelweg für Unternehmen, die Cloud-Komfort wünschen und dabei rechtssicher agieren wollen – ohne Hyperscaler-Funktionsumfang, aber auch ohne CLOUD-Act-Risiko.

Dedizierte Server bei Hetzner, OVH oder Webtropia kombiniert mit einem durchdachten Open-Source-Stack sind für KMUs mit vorhandener IT-Kompetenz oft die kosteneffizienteste und datenschutzrechtlich sicherste Lösung. Sie skaliert nicht unendlich – aber sie gibt die Kontrolle zurück, hält die Kosten planbar und schließt den CLOUD Act strukturell aus.

There is no cloud. Es gibt nur Entscheidungen darüber, wessen Computer man für seine Daten nutzt – und welche rechtlichen, wirtschaftlichen und sicherheitstechnischen Konsequenzen diese Entscheidung hat. Wer das einmal verinnerlicht hat, trifft bessere Entscheidungen für sein Unternehmen.